4 cách để ngăn chặn và hạn chế tác động của deepfake trong năm 2024

An toàn thông tin - Ngày đăng : 17:17, 26/02/2024

4 cách để ngăn chặn và hạn chế tác động của deepfake trong năm 2024

Thông tin sai lệch được xếp hạng là một trong những rủi ro toàn cầu hàng đầu vào năm 2024, trong đó deepfake là một trong những ứng dụng AI đáng lo ngại nhất khi nó có thể bị lạm dụng để thao túng chính trị, tạo ra thông tin sai lệch gây hậu quả nghiêm trọng.

Deepfake là một trong những ứng dụng AI đáng lo ngại nhất

Trong thời đại số phát triển nhanh chóng, công nghệ trí tuệ nhân tạo (AI) và mô hình ngôn ngữ lớn (LLM) ngày càng trở nên phổ biến đã dẫn đến sự xuất hiện nhiều sản phẩm deepfake ngày càng tinh vi.

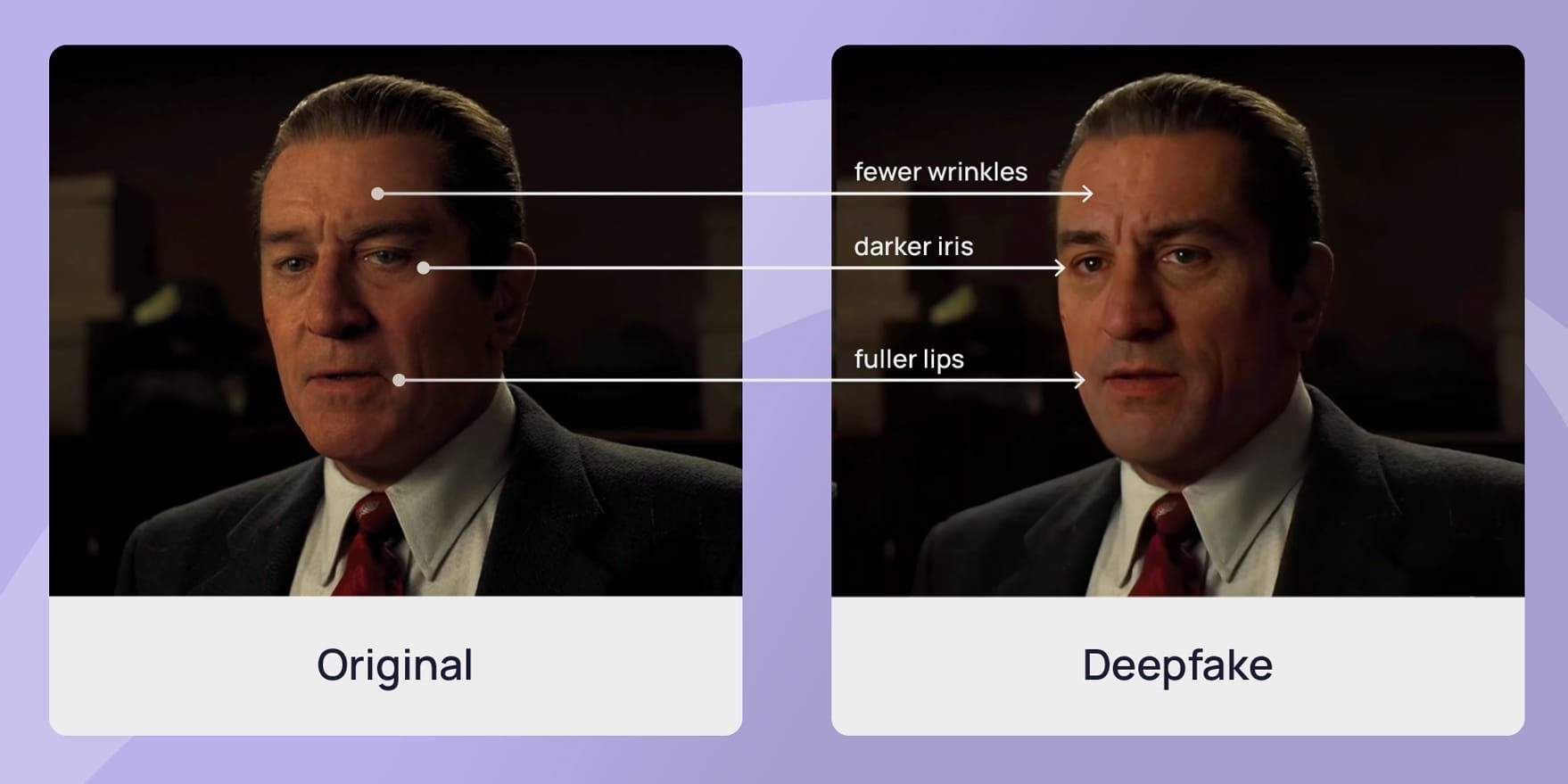

Deepfake - một kỹ thuật tổng hợp hình ảnh, âm thanh hoặc video để tạo ra những nội dung giả mạo, nhằm gây hiểu nhầm cho người xem. Chúng có thể trông thật đến mức khó nhận diện là giả mạo.

Công nghệ này mang lại nhiều lợi ích trong ngành công nghiệp giải trí, nhưng khi bị lợi dụng bất chính, deepfake có thể trở thành một vũ khí nguy hiểm trong tay những kẻ xấu. Deepfake có thể tạo ra thông tin chính trị sai lệch làm ảnh hưởng đến kết quả bầu cử, gây chia rẽ xã hội, làm mất uy tín của các nhà lãnh đạo hoặc thậm chí kích động căng thẳng địa chính trị.

Diễn đàn Kinh tế Thế giới (WEF) đã xếp thông tin sai lệch là một trong những rủi ro hàng đầu năm 2024. Và deepfake đã được xếp hạng là một trong những ứng dụng đáng lo ngại nhất của AI.

Đặc biệt, với khả năng tiếp cận các công cụ genAI ngày càng dễ dàng, việc tạo ra các sản phẩm deepfake ngày nay không cần đòi hỏi hiểu biết nhiều về kỹ thuật và chi phí vẫn có thể tạo ra các video, âm thanh hoặc hình ảnh chân thực, càng khiến cho công nghệ này ngày càng trở nên nguy hiểm.

Chẳng hạn như, nhà phát triển công nghệ Countercloud đã sử dụng các công cụ AI có sẵn rộng rãi để tạo ra các bài viết và tweet chống đối Nga chỉ với chi phí khoảng 400 USD, cho thấy việc tạo ra chiến dịch tuyên truyền thông tin sai lệch trên quy mô lớn đã trở nên rẻ và dễ dàng như thế nào.

Chi phí thấp, dễ dàng tiếp cận đang làm trầm trọng thêm các vấn đề thông tin sai lệch hiện có, đặc biệt khi nó được sử dụng để thao túng chính trị và chia rẽ xã hội. Theo WEF, từ ngày 8/12/2023 đến ngày 8/1/2024, đã xác định được hơn 100 video deepfake giả mạo Thủ tướng Anh Rishi Sunak được chạy quảng cáo trên Meta, nhiều trong số đó đã gây phản ứng tiêu cực trong công chúng.

Từ thực tế đó, bà Anna Maria Collard, Phó Chủ tịch phụ trách Chiến lược nội dung và nhà truyền giáo của KnowBe4 châu Phi nhấn mạnh, chúng ta không thể đánh giá thấp tiềm năng của deepfake trong việc lan truyền thông tin sai lệch nhằm phá vỡ các quá trình dân chủ, bóp méo danh tiếng của các nhà lãnh đạo và kích động tình trạng bất ổn trong công chúng, đặc biệt là trong bối cảnh phương tiện truyền thông số ngày càng được tích hợp trong các chiến dịch chính trị.

Trong tương lai, khi công nghệ deepfake ngày càng phát triển tinh vi, có thể tạo ra các video thao túng công chúng hiệu quả và được cá nhân hóa cao, làm trầm trọng thêm những rủi ro mà chúng ta gặp phải hiện nay.

Ngoài ra, bản chất phi tập trung của Internet, những thay đổi trong luật pháp quốc tế về quyền riêng tư, cũng như sự phát triển không ngừng của AI cũng sẽ là thách thức lớn trong việc hạn chế và ngăn chặn các tác phẩm deepfake độc hại.

Giải pháp ngăn chặn

Đầu tư vào công nghệ phát hiện deepfake

Khi cuộc chạy đua giữa những người tạo ra deepfake và các nhà phát triển công nghệ vẫn tiếp tục, nhiều phần mềm và ứng dụng khác nhau đã được phát triển, tận dụng các thuật toán tiên tiến và AI để phân tích nội dung nhằm tìm ra khả năng thao túng, cũng như những điểm không nhất quán thường liên quan đến các sản phẩm deepfake.

Bên cạnh đó, các phương pháp phân tích thao tác trên khuôn mặt có thể được sử dụng để xác minh tính xác thực của một phần nội dung. Tuy nhiên, việc tạo ra và duy trì các công cụ tự động phát hiện và thực hiện phân tích theo thời gian thực vẫn là một thách thức.

Trong bối cảnh đó, việc nghiên cứu và đầu tư vào công nghệ tiên tiến được thiết kế đặc biệt để phát hiện các tác phẩm deepfake là rất quan trọng. Bằng cách đón đầu xu hướng và áp dụng các giải pháp tiên tiến, có thể gia tăng khả năng phòng thủ trong tương lai trước bối cảnh lừa đảo kỹ thuật số ngày càng phát triển.

Xây dựng chính sách và hướng dẫn

Theo Charmaine Ng, thành viên Hội đồng tương lai toàn cầu của WEF về chính sách công nghệ, chúng ta cần những nỗ lực quốc tế và đa bên để tìm ra những giải pháp khả thi và có thể thực hiện được đối với vấn đề toàn cầu về deepfake. Với Đạo luật AI được đề xuất ở châu Âu, Sắc lệnh hành pháp về AI ở Mỹ, các chính phủ đang cố gắng đưa ra mức độ chịu trách nhiệm và sự tin cậy vào hệ thống AI bằng cách thông báo cho người dùng về tính xác thực của nội dung.

Các chính phủ đang yêu cầu các nền tảng trực tuyến phát hiện và gắn nhãn nội dung do AI tạo ra, đồng thời yêu cầu các nhà phát triển genAI xây dựng các biện pháp bảo vệ nhằm ngăn chặn những kẻ xấu sử dụng công nghệ này để tạo ra các tác phẩm deepfake độc hại.

Việc yêu cầu các nhà cung cấp genAI và LLM nhúng khả năng truy xuất nguồn gốc và hình mờ kỹ thuật số vào quy trình tạo deepfake trước khi phân phối, có thể nâng cao trách nhiệm giải trình và cảnh báo nội dung đó có phải là giả mạo hay không. Đây như một lớp bảo vệ bổ sung nhằm mục đích vừa nâng cao nhận thức cộng đồng, vừa giúp các nền tảng dễ dàng thu thập và loại bỏ nội dung deepfake gây hại.

Tuy nhiên, kẻ xấu cũng có thể phá vỡ những rào cản này bằng cách sử dụng các phiên bản bẻ khóa hoặc tạo các công cụ không tuân thủ của riêng chúng. Do đó, bà Anna Maria Collard nhấn mạnh, cần có sự đồng thuận quốc tế về các tiêu chuẩn đạo đức, định nghĩa về cách sử dụng được chấp nhận và phân loại những gì cấu thành nên một sản phẩm deepfake độc hại để tạo ra một mặt trận thống nhất chống lại việc lạm dụng công nghệ này.

Trong các tổ chức, việc thiết lập các chính sách và hướng dẫn rõ ràng để giải quyết các rủi ro liên quan đến deepfake là rất quan trọng. Bằng cách kết hợp các chiến lược phòng thủ deepfake vào hoạt động, các tổ chức, doanh nghiệp có thể tự bảo vệ mình tốt hơn trước những hậu quả tiềm ẩn của deepfake, như đào tạo nhân viên cách nhận biết và báo cáo các mối đe dọa tiềm ẩn, nuôi dưỡng văn hóa nhận thức và trách nhiệm giải trình...

Sức mạnh của nhận thức: Giáo dục bản thân và người khác

Kiến thức là tuyến phòng thủ đầu tiên chống lại deepfake. Do đó, bản thân mỗi cá nhân cần luôn cập nhật về những phát triển mới nhất trong công nghệ deepfake, trang bị những kỹ năng cần thiết để có thể xác định được nội dung deepfake, hiểu cách thức công nghệ này hoạt động, cũng như các chiến thuật kỹ thuật tâm lý và xã hội mà các tác nhân độc hại sử dụng.

Theo bà Anna Maria Collard, các chương trình kiến thức truyền thông phải ưu tiên trang bị cho mọi người những công cụ để xác minh thông tin họ tiếp nhận. Nghiên cứu đã chỉ ra rằng hiểu biết về truyền thông là một kỹ năng mạnh mẽ có khả năng bảo vệ xã hội chống lại những thông tin sai lệch do AI cung cấp, bằng cách hạn chế chia sẻ những thông tin deepfake sai lệch của một người.

Bằng cách nâng cao nhận thức của bản thân, cá nhân mỗi người không chỉ trở thành người tiêu dùng truyền thông thận trọng và thông thái hơn, mà còn là người tuyên truyền cho chính những người thân, bạn bè, đồng nghiệp của mình hiểu và nhận thức được những rủi ro tiềm ẩn của công nghệ này. Khuyến khích họ đặt câu hỏi về tính xác thực của nội dung, đặc biệt nếu nội dung đó có vẻ quá giật gân hoặc bất thường.

Nâng cao nhận thức là một nỗ lực tập thể và càng nhiều người biết về deepfake thì chúng ta càng có thể cùng nhau chống lại tác động của chúng tốt hơn.

Tư duy “không tin cậy”

Trong an ninh mạng, cách tiếp cận “không tin cậy” có nghĩa là mặc định không tin tưởng bất cứ điều gì và thay vào đó xác minh mọi thứ. Khi áp dụng tư duy này trong quá trình tiêu thụ thông tin trực tuyến, nó đòi hỏi một mức độ hoài nghi lành mạnh và xác minh liên tục. Việc thúc đẩy văn hóa “tư duy không tin cậy” thông qua các chương trình đào tạo an ninh mạng giúp trang bị cho người dùng khả năng đối phó với deepfake và các mối đe dọa mạng khác của AI, mà nếu chỉ có riêng công nghệ thì khó có thể ngăn chặn được.

Đặc biệt, trong bối cảnh khi chúng ta ngày càng tham gia sâu vào cuộc sống trực tuyến và với việc metaverse sắp trở thành hiện thực, tư duy “không tin cậy” càng trở nên phù hợp hơn. Trong những môi trường nhập vai này, việc phân biệt đâu là thật và đâu là giả sẽ rất quan trọng.

Không có cách tiếp cận “viên đạn bạc” nào trong việc giảm thiểu hiệu quả tác động của các mối đe dọa từ deepfake trong không gian kỹ thuật số. Thay vào đó, chúng ta cần phải có một cách tiếp cận đa tầng, kết hợp công nghệ phát hiện AI mới nhất với các chính sách và hướng dẫn, cùng với việc nâng cao nhận thức của công chúng.

Đồng thời, các nhà lãnh đạo nên áp dụng "tư duy không tin cậy", cùng nhau thúc đẩy sự cảnh giác cần thiết và xác minh liên tục để ngăn chặn hiệu quả các mối đe dọa tiềm tàng do rủi ro toàn cầu đang gia tăng này gây ra.

“Điều này đòi hỏi sự hợp tác toàn cầu giữa các quốc gia, tổ chức và xã hội dân sự, cũng như sự quyết tâm chính trị lớn”, bà Anna Maria Collard khẳng định./.