Gia tăng rủi ro từ deepfake khi Hàn Quốc bước vào cuộc bầu cử

Mối đe dọa về video và hình ảnh deepfake đang gia tăng trước cuộc bầu cử quốc hội Hàn Quốc dự kiến diễn ra vào ngày 10/4 tới đây, đặt ra một thách thức nghiêm trọng đối với cơ quan giám sát bầu cử và cử tri về những nguy cơ tiềm ẩn của công nghệ này đối với những lá phiếu của người dân Xứ Kim chi.

Công nghệ deepfake sử dụng trí tuệ nhân tạo (AI) để tạo các video và hình ảnh giả mạo ngày càng trở nên phổ biến. Đáng lo ngại hơn, thông tin giả do deepfake tạo ra thường lan truyền rất nhanh, còn được xem là mối đe dọa mới nổi đối với các cuộc bầu cử và hoạt động chính trị trong bối cảnh tình trạng lừa đảo ngày càng nhiều và liên tục biến tướng.

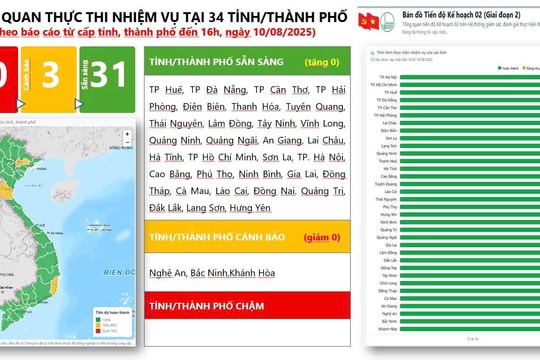

Theo Ủy ban Bầu cử quốc gia (NEC) của Hàn Quốc, từ ngày 29/1 cho đến ngày 16/2, cơ quan này đã phát hiện 129 trường hợp nội dung liên quan đến bầu cử sử dụng công nghệ deepfake, một con số đáng kể và dự kiến sẽ tiếp tục tăng lên khi ngày bầu cử đến gần. Điều này đã vi phạm Luật Bầu cử mới sửa đổi và người vi phạm có thể bị phạt tới 7 năm tù hoặc 50 triệu won (37.500 USD).

NEC đã phát hiện ra các deepfake “có động cơ chính trị” bằng cách sàng lọc các nền tảng cộng đồng trực tuyến và mạng xã hội lớn, đồng thời đang nỗ lực chủ động ngăn chặn các tin giả, tin sai sự thật liên quan bầu cử.

Deepfake đề cập đến những nội dung hình ảnh, âm thanh và video bắt chước chặt chẽ thực tế thông qua việc sử dụng AI. Sự phát triển nhanh chóng của AI trong vài năm qua đã cho phép tạo ra những nội dung giả mạo thế hệ mới với độ chân thực cao tới mức được xem như mối đe dọa đáng kể đối với các chiến dịch chính trị trước các cuộc bầu cử.

Bên ngoài Hàn Quốc, các công ty công nghệ toàn cầu đã hợp lực để giảm thiểu tác động tiêu cực từ tin giả do AI tạo ra, đặc biệt là khi các cuộc bầu cử được tổ chức ở 76 quốc gia trong năm nay.

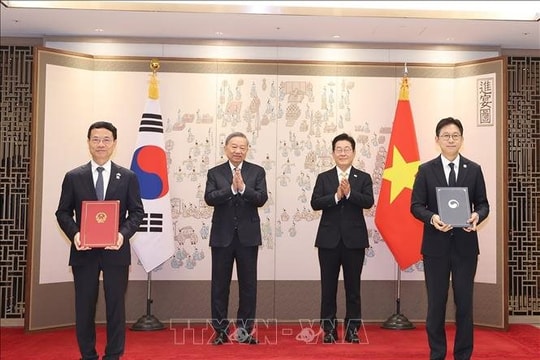

Tại Hội nghị An ninh Munich (Đức) ngày 16/2 mới đây, các công ty công nghệ hàng đầu thế giới bao gồm Adobe, Amazon, Google, Meta, Microsoft, OpenAI và TikTok,... đã ký một hiệp định nhằm ngăn chặn các nội dung giả mạo về chính trị do AI tạo ra. Theo thỏa thuận, các bên liên quan sẽ đưa ra giải pháp để phát hiện, gắn nhãn, kiểm soát hình ảnh, video và âm thanh do AI tạo ra nhằm đánh lừa cử tri.

Động thái này diễn ra trong bối cảnh các trường hợp thông tin sai lệch do AI tạo ra như cuộc gọi giả mạo và bản ghi âm mạo danh các ứng cử viên có nguy cơ can thiệp vào kết quả bầu cử. Các công ty công nghệ hy vọng rằng sự hợp tác này sẽ đóng góp vào việc giữ gìn tính minh bạch và công bằng trong quá trình bầu cử toàn cầu

Hôm thứ Ba vừa qua, hai cổng thông tin lớn của Hàn Quốc cũng tuyên bố sẽ thực hiện các hoạt động nhằm chống lại deepfake do AI tạo ra. Naver, cổng thông tin lớn nhất tại Hàn Quốc, cho biết dịch vụ AI dựa trên chatbot của họ sẽ không đáp ứng yêu cầu của người dùng về việc tạo ra “nội dung không phù hợp” như bố cục của hình ảnh khuôn mặt. Naver cho biết họ đang điều hành một nhóm giám sát chuyên phát hiện các bài đăng trực tuyến vi phạm quy định bầu cử, đồng thời phân tích các kiểu nội dung lạm dụng mới như deepfake.

Kakao, ứng dụng nhắn tin di động thống trị của Hàn Quốc, cũng cho biết họ đang xem xét việc áp dụng công nghệ hình mờ cho nội dung do dịch vụ AI của mình tạo ra, tuy nhiên lộ trình triển khai cụ thể vẫn chưa được xác định.

Tuần trước, OpenAI đã gây chấn động thế giới với việc ra mắt một ứng dụng mới có tên Sora với khả năng tạo video từ văn bản có độ chân thật đến mức kinh ngạc. Công nghệ này có khả năng làm tăng tốc độ làm việc của các nhà làm phim, đồng thời thay thế hoàn toàn những nghệ sĩ kỹ thuật số ít kinh nghiệm. Tuy nhiên, điều đáng lo ngại nhất là Sora có thể trở thành một công cụ tạo ra hình ảnh, thông tin sai lệch một cách nhanh chóng và tiết kiệm chi phí khiến các chuyên gia lo ngại về rủi ro của video deepfake trong cuộc bầu cử toàn cầu vào năm 2024.

Đối mặt với sự phát triển nhanh chóng của công nghệ deepfake, các quan chức bầu cử, cổng thông tin và các nhà cung cấp dịch vụ AI của Hàn Quốc đang kêu gọi nỗ lực chung để tăng cường các giải pháp xác minh và phát hiện deepfake./.