Có thể bạn sẽ bắt đầu hơi bối rối, đặc biệt là nếu trí thông minh nhân tạo (AI) trong câu hỏi đang sử dụng thông tin này theo cách kiểm soát các cơ hội hoặc tùy chọn có sẵn cho bạn.

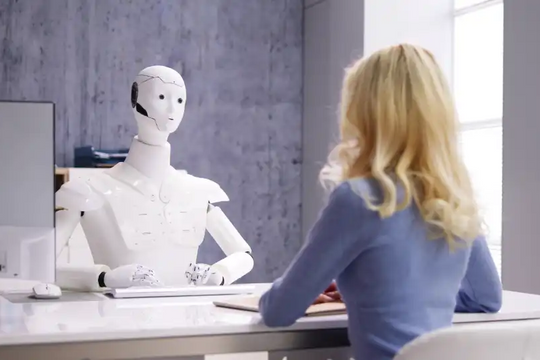

Khám phá khía cạnh trí thông minh nhân tạo này là một dự án mới từ các nhà nghiên cứu tại Đại học Melbourne ở Úc. Lấy mẫu gương sinh trắc học thông minh, thiết bị của họ sử dụng công nghệ nhận dạng khuôn mặt để phân tích khuôn mặt của người dùng và sau đó trình bày đánh giá dưới dạng 14 đặc điểm khác nhau mà nó đã "học" từ những gì được nhìn thấy.

"Ban đầu, hệ thống khá bí mật về những gì sẽ xảy ra", Tiến sĩ Niels Wouters, một trong những nhà nghiên cứu làm việc trong dự án, nói với Digital Trends. "Không có gì hơn, "này, bạn có muốn xem những gì máy tính biết về bạn?' là những gì thu hút mọi người. Nhưng khi họ đồng ý tiến hành và hình ảnh của họ được chụp, nó dần dần cho cá nhân phản hồi có thể nhận được."

Như Wouters chỉ ra, các vấn đề xuất hiện ngay từ đầu, mặc dù không phải tất cả người dùng đều có thể nhận ra ngay. Ví dụ, hệ thống chỉ cho phép giới tính nhị phân, và chỉ có thể nhận ra năm dân tộc - có nghĩa là một sinh viên châu Á có thể được nhận dạng là người gốc Tây Ban Nha, hoặc một người Úc bản xứ là người châu Phi. Đánh giá sau đó như mức độ trách nhiệm hoặc sự ổn định về cảm xúc của một người có thể sẽ thúc đẩy phản hồi từ những người sử dụng thiết bị.

Ý tưởng là để cho thấy sự nguy hiểm từ sự thiên vị của bộ dữ liệu, và cách mà hành vi có vấn đề hoặc phân biệt đối xử có thể được mã hóa trong các hệ thống học máy. Đây là điều mà Tiến sĩ Safiya Umoja Noble đề cập đến trong cuốn sách gần đây của cô, “Thuật toán của sự đàn áp”.

"Hiện nay, cuộc thảo luận xung quanh những vấn đề như thế này trong AI chủ yếu được dẫn dắt bởi các nhà đạo đức, học giả và kỹ thuật viên," Wouters tiếp tục. “Nhưng với số lượng ngày càng tăng của triển khai AI trong xã hội, mọi người cần phải nhận thức rõ hơn về những gì AI là, những gì nó có thể làm, làm thế nào nó có thể đi sai, và cho dù đó là bước hợp lý tiếp theo trong tiến hóa chúng ta muốn nắm lấy. ”

Với trí thông minh nhân tạo ngày càng được sử dụng để đưa ra phán quyết về mọi thứ từ việc đánh giá một nhân viên cho đến mức độ hung hãn của chúng ta, các thiết bị như Gương sinh trắc học sẽ ngày càng trở nên phổ biến hơn.

.png)