Hiện tượng AI "ngầm" (shadow AI) đang bùng nổ mạnh mẽ trong các doanh nghiệp toàn cầu, đặc biệt nghiêm trọng tại ngành ngân hàng và viễn thông.

Theo BCG, khảo sát[44] trên hơn 10.600 nhân viên tại 11 quốc gia cho thấy:

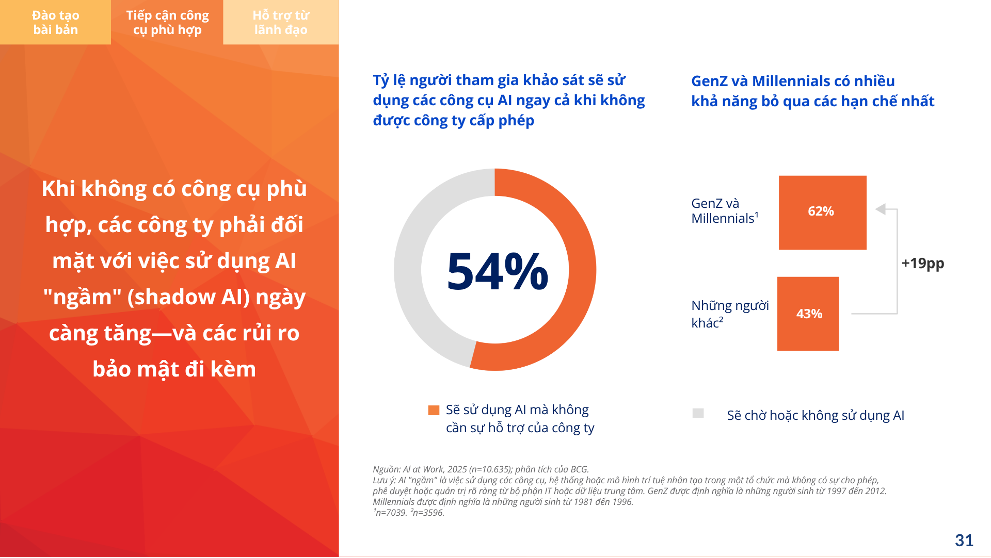

Hơn một nửa (54%) cho biết sẽ sử dụng công cụ AI kể cả khi không được phép hoặc không có hỗ trợ chính thức từ công ty.

Gen Z và Millennials là nhóm “vượt rào” mạnh nhất, với 62% chấp nhận tự dùng AI bên ngoài hệ sinh thái doanh nghiệp, cao hơn 19 điểm phần trăm so với các nhóm tuổi khác

Với tình hình đáng lo ngại này, các tổ chức cần chuyển từ tư duy "cấm đoán" sang "quản lý thông minh" để kiểm soát rủi ro mà vẫn tận dụng được tiềm năng công nghệ.

Bối cảnh và quy mô vấn đề

Thực trạng Shadow AI toàn cầu

Nghiên cứu từ Software AG và các tổ chức uy tín cho thấy shadow AI đã trở thành hiện tượng phổ biến với các con số đáng báo động[1][2][3]. Đặc biệt, trong ngành ngân hàng và viễn thông, việc sử dụng AI không được phê duyệt tăng trưởng 250% chỉ trong năm qua[4].

So sánh tỷ lệ sử dụng AI không được phê duyệt giữa các thế hệ, cho thấy GenZ và Millennials có xu hướng vượt rào cao hơn 19% so với các nhóm tuổi khác.

Thế hệ trẻ, vốn quen thuộc với công nghệ mới, thể hiện xu hướng "vượt rào" cao hơn 19% so với các nhóm tuổi khác. Điều này tạo ra sự phân hóa trong tổ chức và thách thức lớn cho việc quản lý thống nhất[2][3].

Tại sao ngân hàng và viễn thông dễ bị tổn thương?

Khối lượng dữ liệu nhạy cảm kép: Hai ngành này quản lý đồng thời thông tin cá nhân và tài chính của khách hàng, tạo ra "mục tiêu kép" cho các rủi ro bảo mật[5][6]. Khi nhân viên đưa dữ liệu này vào các công cụ AI công cộng, hậu quả có thể nghiêm trọng gấp bội.

Hạ tầng on-premise lạc hậu: Nhiều doanh nghiệp nhà nước và tập đoàn lớn vẫn dựa vào hệ thống cũ, thiếu API an toàn và giao diện thân thiện. Điều này khiến nhân viên tìm đến các giải pháp "đám mây" bên ngoài để được kết quả nhanh chóng[5][7].

Chính sách siết chặt quá mức: Khi quy định nội bộ quá khắt khe mà không đưa ra lựa chọn thay thế khả thi, nhân viên buộc phải "lén lút" sử dụng công cụ bên ngoài[1][8].

Rủi ro pháp lý và tuân thủ

Tác động từ Nghị định 13/2023/NĐ-CP

Tại Việt Nam, Nghị định 13/2023/NĐ-CP về bảo vệ dữ liệu cá nhân đã tạo ra khung pháp lý chặt chẽ[9][10][11]. Điều 15 quy định các hành vi vi phạm có thể dẫn đến phạt nặng và buộc phải công khai vi phạm, tạo áp lực kép về tài chính và danh tiếng[12][13].

Đặc biệt, việc chuyển dữ liệu cá nhân ra nước ngoài thông qua các công cụ AI không được kiểm soát có thể kích hoạt các điều khoản xử phạt nghiêm khắc nhất của nghị định này[10][11].

Tuân thủ quốc tế bị đe dọa

Basel III và quản lý rủi ro: Các ngân hàng phải tuân thủ khung Basel III về quản lý rủi ro tài chính. Khi hoạt động AI diễn ra ngoài hệ thống SIEM, việc theo dõi và báo cáo trở nên không khả thi[14][15].

ISO 27001 và bảo mật thông tin: Tiêu chuẩn ISO 27001 yêu cầu kiểm soát toàn diện các hệ thống xử lý thông tin. Shadow AI tạo ra "điểm mù" trong quản lý bảo mật, có thể làm mất hiệu lực chứng nhận[14][16].

Model memorization: Khi dữ liệu doanh nghiệp được đưa vào các mô hình AI công cộng, thông tin có thể bị "ghi nhớ" và truy xuất ngược bởi người khác, tạo ra rủi ro bảo mật lâu dài[17][18][19].

Giải pháp toàn diện

Khung chính sách "mở nhưng có lan can"

AI Acceptable Use Policy rõ ràng: Thay vì cấm hoàn toàn, doanh nghiệp cần xây dựng chính sách sử dụng AI chấp nhận được với các nguyên tắc cụ thể[20][21][22]:

- Phân loại dữ liệu được phép và cấm sử dụng

- Quy trình gỡ bỏ thông tin định danh (PII) trước khi gửi

- Các trường hợp ngoại lệ và quy trình phê duyệt đặc biệt

Trách nhiệm pháp lý: Bổ sung điều khoản về AI vào hợp đồng lao động để nhân viên hiểu rõ việc "dùng sai" là vi phạm kỷ luật, không phải sáng kiến cá nhân[20][23].

Hạ tầng AI nội bộ tiện lợi

Azure OpenAI Private Endpoint: Triển khai giải pháp Azure OpenAI với private endpoint cho phép tổ chức sử dụng sức mạnh của GPT mà vẫn đảm bảo dữ liệu không rời khỏi môi trường kiểm soát[24][25][26].

Llama-3 self-hosted trong DMZ: Đặt mô hình Llama-3 trong vùng DMZ với các biện pháp bảo mật đa lớp, kết hợp bộ lọc DLP và log toàn bộ prompt[27][28][29].

RAG (Retrieval Augmented Generation): Triển khai hệ thống RAG cho phép AI chỉ truy cập kho tri thức nội bộ, tránh gửi nguyên văn dữ liệu ra bên ngoài[30][31][32].

Văn hóa minh bạch và đào tạo liên tục

Chương trình AI Champions: Xây dựng mạng lưới AI Champions nội bộ - những nhân viên am hiểu công nghệ có thể hỗ trợ đồng nghiệp và thu thập phản hồi[33][34][35]. Các Champions này sẽ:

- Tổ chức hội thảo (workshop) 90 phút với case study thực tế

- Chia sẻ thất bại và bài học kinh nghiệm

- Kênh tư vấn nhanh qua mạng nội bộ

Monitoring thông minh: Đội bảo mật thiết lập dashboard realtime cảnh báo truy vấn bất thường nhưng không "phạt vô tội vạ", nuôi dưỡng niềm tin rằng "nói thật sẽ được hỗ trợ"[36][37][38].

Công nghệ hỗ trợ

Data Loss Prevention (DLP) cho AI

Các giải pháp DLP hiện đại cần được nâng cấp để phát hiện và ngăn chặn việc sử dụng AI không được phê duyệt[39][40][41]:

AI-based content detection: Sử dụng AI để nhận diện các loại dữ liệu nhạy cảm phức tạp

Real-time monitoring: Giám sát thời gian thực các hoạt động AI

Behavioral analysis: Phân tích hành vi người dùng để phát hiện anomaly

SIEM tích hợp AI

Hệ thống SIEM cần được nâng cấp để theo dõi hoạt động AI[42][36][43]:

- Log tất cả các tương tác với các công cụ AI

- Correlation rules đặc biệt cho AI usage patterns

- Automated alerting cho suspicious AI activities

Chiến lược triển khai

Giai đoạn 1: Đánh giá và lập kế hoạch (1-2 tháng)

- Khảo sát thực trạng sử dụng AI trong tổ chức

- Xác định các rủi ro ưu tiên cao

- Thiết kế chính sách AI phù hợp

Giai đoạn 2: Triển khai hạ tầng (3 - 6 tháng)

- Triển khai Azure OpenAI Private Endpoint hoặc self-hosted solution

- Cấu hình DLP rules cho AI usage

- Setup SIEM monitoring

Giai đoạn 3: Đào tạo và triển khai (2 - 3 tháng): Đào tạo AI Champions; Rollout chính sách toàn tổ chức; Continuous monitoring và adjustment

Kết luận

Marcus Aurelius từng nói: "Điều cản trở hành động lại thúc đẩy hành động." Việc cấm đoán AI hoàn toàn không chỉ không hiệu quả mà còn đẩy nhân viên vào "đường hầm tối" của shadow AI.

Thay vào đó, các tổ chức cần chọn cách "thắp đèn ở chính giữa hành lang" - tạo ra môi trường AI an toàn, minh bạch và được quản lý chặt chẽ. Điều này đòi hỏi sự kết hợp khéo léo giữa chính sách thông minh, công nghệ phù hợp và văn hóa tổ chức mở.

Doanh nghiệp nên bắt đầu từ việc xây dựng chính sách rõ ràng, đầu tư vào hạ tầng AI an toàn, và quan trọng nhất là nuôi dưỡng văn hóa minh bạch - nơi nhân viên cảm thấy được hỗ trợ thay vì bị trừng phạt khi sử dụng AI một cách có trách nhiệm.

Trong kỷ nguyên AI, thành công không thuộc về những ai cấm đoán công nghệ, mà thuộc về những ai biết cách khai thác nó một cách thông minh và an toàn.

Tài liệu tham khảo

[1]. https://www.techaheadcorp.com/blog/shadow-ai-the-risks-of-unregulated-ai-usage-in-enterprises/

[2]. https://www.techradar.com/computing/artificial-intelligence/naughty-naughty-more-than-a-third-of-it-workers-are-using-unauthorised-ai-as-the-risks-of-shadow-tech-loom-large

[3]. https://www.unleash.ai/artificial-intelligence/half-of-workers-use-unauthorized-ai-at-work-and-dont-want-to-quit-software-ag/

[4]. https://www.zendesk.com/blog/shadow-ai/

[5]. https://www.linkedin.com/pulse/shadow-ai-finance-risk-realities-executive-strategies-amin-m-eng--d9t6c

[6]. https://vietnamnews.vn/economy/1722377/ai-application-is-key-to-improving-bank-credit-quality.html

[7]. https://www.ibm.com/think/topics/shadow-ai

[8]. https://www.tanium.com/blog/employees-are-embracing-shadow-ai-and-putting-company-data-at-risk/

[9]. https://luatthanhdo.com.vn/noi-dung-chinh-cua-nghi-dinh-13-ve-bao-ve-du-lieu-ca-nhan

[10]. https://vngcloud.vn/vi/blog/key-notes-for-businesses-under-decree-13-2023-nd-cp-on-personal-data-protection

[11]. https://kpmg.com/vn/vi/home/phan-tich-chuyen-sau/2023/04/nghi-dinh-13-ve-bao-ve-du-lieu-ca-nhan.html

[12]. https://congan.longan.gov.vn/vi/chi-tiet-tin-tuc?Id=123017

[13]. https://vbpl.vn/caobang/Pages/vbpq-toanvan.aspx?ItemID=161106

[14]. https://cyberupgrade.net/blog/compliance-regulations/addressing-ai-related-threats-through-iso-27001-compliance/

[15]. https://blog.smartglobalgovernance.com/en/basel-iii-simplify-your-banking-compliance-with-an-integrated-approach/

[16]. https://citationgroup.com.au/resources/how-ai-and-machine-learning-are-revolutionising-iso-27001-compliance/

[17]. https://arxiv.org/html/2503.22760v1

[18]. https://www.donets.org/risks/sensitive-data-leakage-via-memorization

[19]. https://milvus.io/ai-quick-reference/what-are-the-privacy-risks-associated-with-llms

[20]. https://www.deel.com/resources/ai-acceptable-use-policy-template

[21]. https://lattice.com/templates/ai-usage-policy-template

[22]. https://witness.ai/blog/ai-policy-template/

[23]. https://www.techtarget.com/searchsecurity/tip/How-to-create-an-AI-acceptable-use-policy-plus-template

[24]. https://techcommunity.microsoft.com/blog/azurearchitectureblog/azure-openai-private-endpoints-connecting-across-vnet’s/3913325

[25]. https://learn.microsoft.com/en-us/azure/ai-foundry/openai/how-to/network

[26].https://trendmicro.com/cloudoneconformity/knowledge-base/azure/AIServices/use-private-endpoints.html

[27].https://www.reddit.com/r/LocalLLaMA/comments/1dtshho/selfhost_llama_3_on_your_own_cloud_in_python/

[28]. https://www.run.house/blog/how-to-use-llama-3-self-hosted

[29]. https://brainsteam.co.uk/2024/04/20/self-hosting-llama-3-on-a-home-server/

[30]. https://coralogix.com/ai-blog/rag-in-production-deployment-strategies-and-practical-considerations/

[31]. https://www.stack-ai.com/blog/enterprise-rag-what-it-is-and-how-to-use-this-technology

[32]. https://www.codiste.com/implementing-agentic-rag-enterprise-guide

[33]. https://www.the-prompt.ai/workshop-org/becoming-an-ai-champion:-how-to-lead-ai-in-your-workplace

[34].https://www.cambridgespark.com/blog/what-is-ai-champion

[35]. https://www.linkedin.com/pulse/3-steps-fostering-team-generative-ai-champions-googleworkspace-8yq4e

[36]. https://www.sentinelone.com/cybersecurity-101/data-and-ai/siem-log-monitoring/

[37]. https://www.sentinelone.com/cybersecurity-101/data-and-ai/siem-use-cases/

[38]. https://www.detectionatscale.com/p/the-agentic-siem

[39]. https://www.nightfall.ai/blog/the-best-data-loss-prevention-solutions

[40]. https://www.lighthouseglobal.com/blog/ai-data-loss-prevention

[41]. https://www.lakera.ai/blog/data-loss-prevention

[42]. https://www.freecodecamp.org/news/how-to-create-a-python-siem-system-using-ai-and-llms/

[43]. https://www.elastic.co/blog/9-benefits-of-ai-driven-siem-security

[44]. https://www.bcg.com/publications/2025/ai-at-work-momentum-builds-but-gaps-remain./.