Microsoft Trustworthy AI: Khai phá AI an toàn và có trách nhiệm

Trí tuệ nhân tạo đang len lỏi vào mọi ngóc ngách của cuộc sống, từ các ứng dụng ngân hàng cho đến các trợ lý ảo. Bên cạnh những lợi ích mang lại, AI cũng tiềm ẩn không ít nguy cơ và thách thức đáng lo ngại. Trustworthy AI chính là một cách tiếp cận phát triển AI ưu tiên sự an toàn và minh bạch cho những người tương tác với nó.

Theo hãng nghiên cứu và tư vấn thị trường kỹ thuật số Gartner (Mỹ), năm 2024 tiếp tục sẽ là một năm phát triển mạnh mẽ của AI. Đây cũng là lĩnh vực được các cường quốc đầu tư mạnh mẽ và là vấn đề thu hút giới nghiên cứu khắp nơi trên thế giới.

Từ những góc nhìn khác nhau, người ta hi vọng vào tiềm năng to lớn của AI nhưng cũng không ngừng lo ngại những nguy cơ tiêu cực mà AI mang lại. Câu hỏi đặt ra, liệu rằng khung pháp lý và các quy định hiện hành đã đủ và kịp thời để điều chỉnh sự phát triển của AI hay chưa?

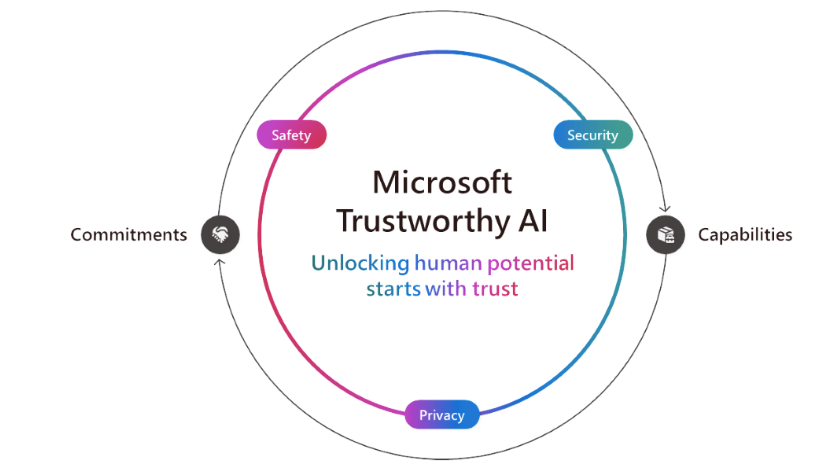

Theo ông Takeshi Numoto, Phó Chủ tịch điều hành kiêm Giám đốc Marketing của Microsoft, Khi AI phát triển, chúng ta đều có vai trò nhất định trong việc khai phá những tác động tích cực của AI. Đó là lý do tại sao Microsoft tập trung vào việc giúp khách hàng ứng dụng và xây dựng AI một cách đáng tin cậy (Trustworthy AI), để đảm bảo tính bảo mật, an toàn và quyền riêng tư.

"Tại Microsoft, chúng tôi cam kết mang đến công nghệ AI đáng tin cậy và hôm nay, Microsoft chính thức công bố những tính năng mới nhằm tăng cường tính bảo mật, an toàn và quyền riêng tư của các hệ thống AI do chúng tôi cung cấp", ông Takeshi Numoto nhấn mạnh .

Đầu tiên, bảo mật là ưu tiên hàng đầu tại Microsoft và sáng kiến Secure Future Initiative (SFI) của Microsoft nhấn mạnh các cam kết và trách nhiệm trong việc đảm bảo sự an toàn hơn nữa cho khách hàng.

Mới đây, Microsoft cũng vừa công bố bản Báo cáo Tiến độ đầu tiên của sáng kiến này, nêu bật các cập nhật về văn hoá, quản trị, công nghệ và vận hành, thể hiện cam kết của công ty trong việc đặt tính bảo mật là ưu tiên hàng đầu, được định hướng trên ba nguyên tắc: bảo mật theo thiết kế, bảo mật theo mặc định và bảo mật trong các hoạt động.

"Dựa trên những điều này, hôm nay chúng tôi công bố hai tính năng mới: Tính năng đánh giá Evaluations trong Azure AI Studio để hỗ trợ đánh giá rủi ro một cách chủ động; Tính minh bạch trong các truy vấn web của Microsoft 365 Copilot cho phép quản trị viên và người dùng hiểu rõ hơn về cách tìm kiếm giúp nâng cao phản hồi của Copilot", ông Takeshi Numoto cho biết.

Phó Chủ tịch điều hành kiêm Giám đốc Marketing của Microsoft chia sẻ những tính năng bảo mật của công ty đã được nhiều khách hàng trên thế giới tin tưởng sử dụng. Cummins, một công ty có tuổi đời 105 năm nổi tiếng trong việc chế tạo động cơ và phát triển công nghệ năng lượng sạch, đã chuyển sang sử dụng Microsoft Purview để tăng cường bảo mật dữ liệu và quản trị bằng cách tự động hoá việc phân loại, gắn thẻ và dán nhãn dữ liệu. EPAM Systems, một công ty tư vấn kinh doanh và kỹ thuật phần mềm đã quyết định triển khai Microsoft 365 Copilot cho 300 người dùng vì sự bảo mật dữ liệu mà họ nhận được từ Microsoft.

Thứ hai, các nguyên tắc AI có trách nhiệm (Responsible AI) được mở rộng tiếp tục định hướng cách Microsoft xây dựng và triển khai AI một cách an toàn trên toàn công ty.

Microsoft xây dựng, thử nghiệm và giám sát các hệ thống một cách phù hợp để tránh các hành vi không mong muốn, như nội dung có hại, thiên vị, sử dụng sai mục đích và các rủi ro khác. Microsoft cam kết chia sẻ những bài học kinh nghiệm của mình trong hành trình duy trì các nguyên tắc AI có trách nhiệm với khách hàng, để cung cấp cho họ các khả năng và công cụ xây dựng các ứng dụng AI có cùng các tiêu chuẩn như chúng tôi.

"Hôm nay, chúng tôi cũng chia sẻ các khả năng mới giúp khách hàng không chỉ theo đuổi các lợi ích của AI, mà còn giảm thiểu rủi ro. Trong đó, correction là khả năng sửa lỗi trong tính năng phát hiện tính chính xác của Microsoft Azure AI Content Safety giúp khắc phục các sự cố ảo giác theo thời gian thực trước khi người dùng nhìn thấy chúng. Embedded Content Safety là khả năng bảo mật nội dung cho phép khách hàng nhúng Azure AI Content Safety trên các thiết bị.

New evaluations là khả năng đánh giá mới trong Azure AI Studio giúp khách hàng đánh giá chất lượng và mức độ liên quan của đầu ra cũng như tần suất ứng dụng AI của họ đưa ra nội dung được bảo vệ. Protected Material Detection for Code là tính năng phát hiện nội dung, hiện đang ở chế độ xem trước, trong Azure AI Content Safety với khả năng phát hiện nội dung và mã đã tồn tại từ trước. Tính năng này giúp các nhà phát triển khám phá mã nguồn công khai trong kho lưu trữ GitHub, thúc đẩy sự cộng tác và minh bạch, đồng thời cho phép đưa ra các quyết định mã hóa sáng suốt hơn", đại diện Microsoft cho biết.

Các giải pháp của Microsoft đang được sử dụng để xây dựng các ứng dụng AI an toàn và đáng tin cậy hơn. New York City Public Schools đã hợp tác với Microsoft để phát triển một hệ thống trò chuyện an toàn và phù hợp với bối cảnh giáo dục, hiện đang được thử nghiệm tại các trường học.

Tương tự, The South Australia Department for Education cũng đã đưa AI tạo sinh vào lớp học với EdChat, dựa trên cùng một cơ sở hạ tầng để đảm bảo sử dụng an toàn cho học sinh và giáo viên.

Thứ ba là quyền riêng tư. Dữ liệu là nền tảng của AI và ưu tiên của Microsoft là giúp đảm bảo dữ liệu của khách hàng được bảo vệ và tuân thủ thông qua các nguyên tắc bảo mật lâu đời của công ty, bao gồm kiểm soát người dùng, tính minh bạch và bảo vệ pháp lý và quy định.

"Với các khả năng mới giúp cải thiện tính bảo mật, an toàn và quyền riêng tư, Microsoft sẽ tiếp tục giúp khách hàng sử dụng và xây dựng các giải pháp AI đáng tin cậy, hỗ trợ mọi cá nhân và tổ chức trên thế giới đạt được nhiều thành tựu hơn. Và Trustworthy AI đóng vai trò quan trọng trong sứ mệnh của chúng tôi với nỗ lực khai phá cơ hội, xây dựng lòng tin, bảo vệ các quyền cơ bản và thúc đẩy tính bền vững", ông Takeshi Numoto nhấn mạnh./.

.jpg)

.png)