Chatbot AI có thể mang đến những rủi ro mạng

Anh đang cảnh báo các tổ chức về việc tích hợp các chatbot dựa trên trí tuệ nhân tạo (AI) vào hoạt động kinh doanh của họ. Nghiên cứu ngày càng chỉ ra rằng họ có thể bị lừa vào những tác vụ có hại.

Trung tâm an ninh mạng của Anh (NCSC) cho biết, các chuyên gia vẫn chưa nắm bắt được những vấn đề bảo mật tiềm ẩn gắn liền với các thuật toán có thể tạo ra những tương tác giống con người.

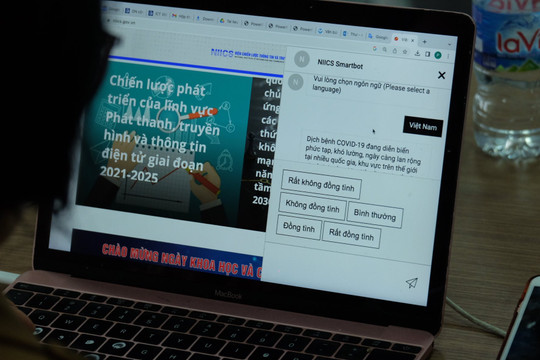

Các chatbot AI, được gọi là nhưng mô hình ngôn ngữ lớn (LLM) đang ngày càng được sử dụng nhiều như là các công cụ cho các mục đích khác nhau, bao gồm cuộc gọi bán hàng và dịch vụ khách hàng.

NCSC nhấn mạnh rằng việc kết nối các mô hình như vậy với các yếu tố khác trong quy trình kinh doanh của tổ chức có thể mang lại những rủi ro đáng kể. Chẳng hạn, tin tặc có thể thao túng một chatbot hỗ trợ AI do ngân hàng triển khai để thực hiện giao dịch trái phép nếu cấu trúc truy vấn chính xác.

NCSC cho biết: “Các tổ chức xây dựng dịch vụ sử dụng LLM cần phải cẩn thận, giống như khi họ đang sử dụng một sản phẩm hoặc thư viện mã đang ở giai đoạn thử nghiệm. Họ có thể không để sản phẩm đó tham gia thực hiện các giao dịch thay mặt khách hàng và sẽ không hoàn toàn tin tưởng vào sản phẩm đó. Cần thận trọng tương tự đối với LLM."

Các nhà chức trách trên toàn thế giới cũng đang vật lộn với sự gia tăng của LLM như ChatGPT của OpenAI mà các doanh nghiệp đang tích hợp vào một loạt dịch vụ, bao gồm cả bán hàng và chăm sóc khách hàng trong khi các nhà chức trách ở Mỹ và Canada cho biết họ đã chứng kiến các tin tặc nắm bắt công nghệ này.

Các quan chức an ninh mạng hàng đầu của Canada cho biết, tin tặc đang sử dụng AI để tạo ra phần mềm độc hại, soạn thảo email lừa đảo thuyết phục và truyền bá thông tin sai lệch trực tuyến.

Hồi tháng 3, tổ chức cảnh sát châu Âu (Europol) đã công bố một báo cáo nói rằng các mô hình như ChatGPT của OpenAI đã có thể “mạo danh một tổ chức hoặc cá nhân theo cách rất thực tế ngay cả khi chỉ có kiến thức cơ bản về tiếng Anh”.

Cùng tháng đó, trung tâm an ninh mạng quốc gia của Anh cho biết, nguy cơ bọn tội phạm “có thể sử dụng LLM để hỗ trợ các cuộc tấn công mạng vượt quá khả năng hiện tại của chúng”.

Các nhà nghiên cứu an ninh mạng đã chứng minh nhiều nguy cơ tiềm ẩn và một số người hiện cho biết họ đang bắt đầu thấy nội dung bị nghi ngờ do AI tạo ra.

Một cuộc thăm dò gần đây của Reuters/Ipsos cũng cho thấy nhiều nhân viên công ty đang sử dụng các công cụ như ChatGPT để trợ giúp các công việc cơ bản như soạn thảo email, tóm tắt tài liệu và thực hiện nghiên cứu sơ bộ.

Khoảng 10% số người được hỏi cho biết ông chủ của họ đã cấm các công cụ AI bên ngoài, trong khi 1/4 không biết liệu công ty của họ có cho phép sử dụng công nghệ này hay không.

Ông Oseloka Obiora, Giám đốc công nghệ của công ty an ninh mạng RiverSafe cho biết, cuộc đua tích hợp AI vào hoạt động kinh doanh sẽ gây ra “hậu quả thảm khốc” nếu lãnh đạo doanh nghiệp không đưa ra các biện pháp kiểm tra cần thiết.

Cũng theo ông Oseloka Obiora: “Thay vì chạy theo những xu hướng AI mới nhất, các giám đốc điều hành cấp cao nên suy nghĩ lại, đánh giá lợi ích và rủi ro cũng như thực hiện biện pháp bảo vệ mạng cần thiết để đảm bảo tổ chức không bị tổn hại"./.

.jpg)