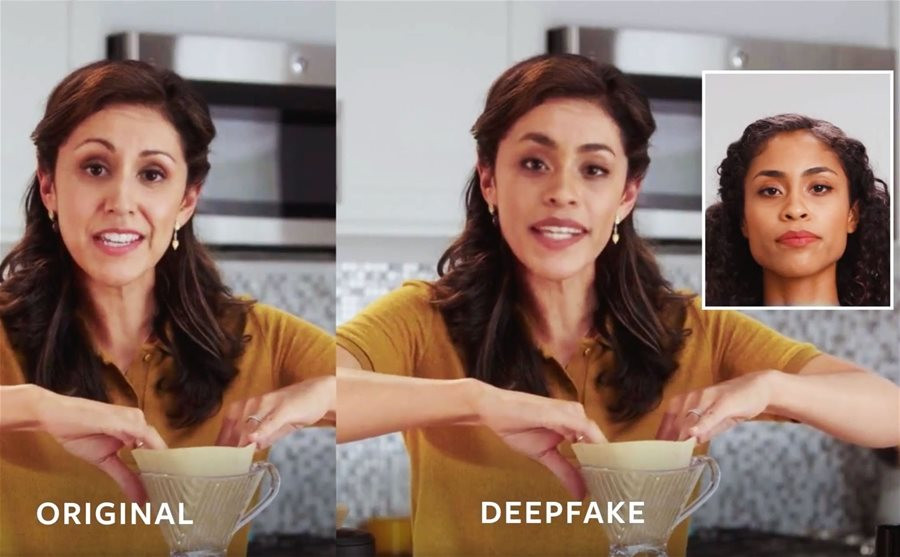

Làm thế nào để hạn chế tác động của công nghệ deepfake?

Trong những năm gần đây, chúng ta đã chứng kiến sự gia tăng nhanh chóng và ngày càng tinh vi của các sản phẩm deepfake. Từ năm 2019 - 2020, số lượng nội dung deepfake trực tuyến đã tăng 900%. Các dự báo cho thấy xu hướng đáng lo ngại này vẫn sẽ tiếp tục gia tăng trong những năm tới.

Deepfake - một kỹ thuật tổng hợp hình ảnh, âm thanh hoặc video để tạo ra những nội dung giả mạo, nhằm gây hiểu nhầm cho người xem, thường được lạm dụng để đánh lừa và thực hiện các cuộc tấn công kỹ thuật xã hội, deepfake làm xói mòn niềm tin vào công nghệ số và gây ra mối đe dọa ngày càng nguy hiểm cho các cá nhân, doanh nghiệp (DN), tổ chức.

Các mối nguy hại của deepfake

Theo một báo cáo của VMware, năm 2022, 66% chuyên gia an ninh mạng đã trải qua các cuộc tấn công deepfake trong các tổ chức của họ.

Tội phạm mạng hiện đang kết hợp deepfake vào các phương thức tấn công của chúng để trốn tránh các biện pháp kiểm soát an ninh. Cụ thể, deepfake được sử dụng để thực hiện các cuộc tấn công lừa đảo như tạo tin nhắn âm thanh giả của các giám đốc điều hành hoặc lãnh đạo cấp cao khác của công ty để mạo danh họ. Những tin nhắn âm thanh deepfake này thường chứa các yêu cầu khẩn cấp để người nhận nhanh chóng chuyển tiền hoặc tiết lộ thông tin nhạy cảm.

Theo một cuộc khảo sát của nhà sản xuất phần mềm xác minh ID Regula, 1/3 số DN được khảo sát đã gặp phải gian lận deepfake bằng giọng nói và video. Trong khi đó, gian lận danh tính do trí tuệ nhân tạo (AI) tạo ra cũng đang gia tăng. Kết quả khảo sát của Regula cho thấy 37% các tổ chức đã gặp phải tình trạng lừa đảo bằng giọng nói và 29% từng là nạn nhân của các video deepfake.

AI liên tục giúp tạo ra các tác phẩm deepfake ngày càng dễ dàng hơn, đặt ra một thách thức lớn đối với các DN cũng như các cá nhân.

Theo Regula, 80% các DN bày tỏ lo ngại các sản phẩm sinh trắc học giả mạo như giả giọng nói hoặc video deepfake là mối đe dọa thực sự. Tại Mỹ, mối lo ngại này dường như là cao nhất, với khoảng 91% các tổ chức tin rằng đây thực sự là một mối đe dọa ngày càng tăng.

Chi phí thiệt hại trong các cuộc tấn công deepfake cũng tương đối cao. Theo số liệu khảo sát của Regula, 26% công ty nhỏ và 38% công ty lớn đã trải qua hơn 50 cuộc tấn công gian lận danh tính liên quan đến deepfake vào năm 2022, với thiệt hại lên tới 480.000 USD.

Ngoài ra, công nghệ deepfake cũng có khả năng tác động và ảnh hưởng đến kết quả bầu cử, làm suy yếu ổn định xã hội và thậm chí là an ninh quốc gia, đặc biệt là trong bối cảnh các chiến dịch thông tin sai lệch ngày càng được sử dụng mạnh mẽ.

Trong một số trường hợp, deepfake đã được sử dụng để thao túng dư luận hoặc lan truyền tin tức giả mạo dẫn đến sự mất lòng tin và nhầm lẫn trong công chúng.

Vai trò của AI đối với nguy cơ deepfake

Khả năng tiếp cận ngày càng tăng của công nghệ AI đặt ra một mối đe dọa mới: các cá nhân có mục đích xấu có thể dễ dàng tạo ra các tác phẩm deepfake hơn, khuếch đại mối đe dọa đối với các DN cũng như cá nhân. Các thuật toán AI, bao gồm cả các mô hình AI tạo sinh, giờ đây có thể tạo ra các sản phẩm khó phân biệt với hình ảnh, video hoặc bản ghi âm thực.

Hơn nữa, các thuật toán này có thể được mua với chi phí thấp và được đào tạo trên các tập dữ liệu dễ truy cập, giúp tội phạm mạng dễ dàng tạo ra các tác phẩm deepfake thuyết phục phục vụ cho các cuộc tấn công lừa đảo.

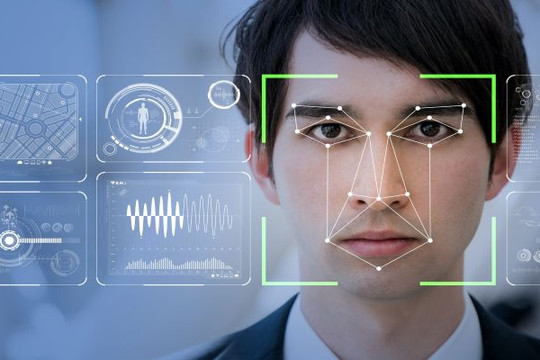

Khi deepfake phát triển, công nghệ và công cụ để phát hiện các mối đe dọa cũng vậy. Giờ đây, các công cụ phát hiện deepfake có thể giúp xác định từ các tính năng sinh trắc học, chẳng hạn như nhịp tim hoặc tần số giọng nói của con người, xem nội dung video hoặc âm thanh có chính xác hay không.

Điều đó cho thấy rằng, là một công nghệ lưỡng dụng, AI cũng có thể phức tạp hóa mọi thứ hơn nữa bằng cách tạo ra nội dung tổng hợp được thiết kế đặc biệt để tránh bị các công cụ phát hiện deepfake hiện tại phát hiện.

Rủi ro kép của deepfake

Lừa đảo deepfake không chỉ gây ra rủi ro đáng kể, mà chúng còn có thể kết hợp với các hoạt động tội phạm mạng khác tạo ra những rủi ro lớn hơn, chẳng hạn như hành vi trộm cắp danh tính.

Ví dụ, deepfake có thể được sử dụng để tạo tài liệu nhận dạng giả, giúp tội phạm mạng dễ dàng mạo danh cá nhân hoặc giành quyền truy cập vào các hệ thống an toàn. Ngoài ra, deepfake có thể được sử dụng để tạo bản ghi âm thanh hoặc video giả của các cá nhân, và sau đó những bản ghi này có thể được sử dụng để tống tiền.

Nghiên cứu của Regula cũng cho thấy lĩnh vực ngân hàng là lĩnh vực dễ bị tổn thương nhất đối với loại gian lận danh tính. Các dịch vụ ngân hàng cá nhân và thanh toán, là mối lo ngại đặc biệt và những lo ngại đó không phải là vô căn cứ. Một ví dụ điển hình đó là một giám đốc ngân hàng đã bị tội phạm mạng sử dụng công nghệ AI để sao chép giọng nói của một giám đốc công ty lừa chuyển 35 triệu USD vào tài khoản lừa đảo.

Ngược lại, hành vi trộm cắp danh tính có thể làm trầm trọng thêm rủi ro do các vụ lừa đảo deepfake gây ra. Chẳng hạn, tội phạm mạng có thể sử dụng danh tính bị đánh cắp để tạo ra các sản phẩm deepfake thuyết phục hơn, hoặc sử dụng deepfake để thực hiện thêm hành vi trộm cắp danh tính.

Để giảm thiểu những rủi ro kép này, chúng ta cần phải thực hiện một cách tiếp cận đa hướng như đầu tư vào các công nghệ phát hiện deepfake tinh vi hơn, cũng như cải thiện các hệ thống xác minh danh tính, trong đó bao gồm cả việc sử dụng xác minh sinh trắc học, để ngăn chặn việc lạm dụng deepfake trong hành vi trộm cắp danh tính.

Các giải pháp tiềm năng

Để giải quyết các mối đe dọa mới nổi này, theo các chuyên gia của Diễn đàn kinh tế thế giới (WEF), chúng ta phải tiếp tục phát triển và cải thiện các công nghệ phát hiện deepfake. Điều này có thể liên quan đến việc sử dụng các thuật toán phức tạp hơn, cũng như phát triển các phương pháp mới có thể xác định deepfake dựa trên bối cảnh, siêu dữ liệu hoặc các yếu tố khác của chúng.

Một giải pháp tiềm năng khác là nâng cao hiểu biết và nhận thức về phương tiện truyền thông và tư duy phản biện. Bằng cách tuyên truyền, nâng cao nhận thức cho người dân hiểu về sự nguy hiểm của deepfake và cách phát hiện chúng, chúng ta có thể giảm và hạn chế tác động của các chiến dịch độc hại này.

Cuối cùng, chúng ta phải xem xét ý nghĩa đạo đức của AI và công nghệ deepfake. Chính phủ và các cơ quan quản lý có thể đóng một vai trò quan trọng trong việc định hình các chính sách điều chỉnh công nghệ deepfake và thúc đẩy việc phát triển và sử dụng công nghệ một cách minh bạch, có trách nhiệm. Bằng cách đó, chúng ta có thể đảm bảo rằng AI không gây hại.

Tóm lại, công nghệ deepfake là một mối đe dọa ngày càng tăng, đặc biệt là trong tay tội phạm mạng. Với sự phát triển của AI, những rủi ro do deepfake gây ra ngày càng trở nên nghiêm trọng hơn. Tuy nhiên, với sự phát triển của các công nghệ phát hiện mới và việc tiếp tục tập trung vào các cân nhắc về giáo dục và đạo đức, chúng ta có thể hợp tác để giảm thiểu những rủi ro này và đảm bảo rằng công nghệ deepfake được sử dụng cho những lợi ích lớn hơn./.